By Tom Everitt, DeepMind

Translated by Xiaohu Zhu, Founder of University AI, contact: neil@universityai.com

我们在最新的论文中,描述了一个新的推断智能体动机的方法。该方法基于影响图,这是一种图模型的类型,包含特别的决策和效用节点。图标准可以被用来确智能体观测动机和智能体干预动机

对人类来说,将智能系统考虑成希望通过采取行动达成目标的智能体。“猫回家是因为饿了想吃东西”。这个意向的概念对机器学习系统同样自然。这些系统通常被训练来优化某些目标函数(如,一个损失或者奖励函数),就自然可以说他们“想要”做一些事。智能体角度可能对理解变得越来越强大和复杂的机器学习系统更加有用。

智能体的目标和智能体的动机其实可以被区分开来。目标是智能体最终优化的东西,如一个损失函数或者奖励函数。目标促使对优化目标会有贡献的事件动机出现。例如,ATARI游戏乒乓球的奖励函数促使一个将板子移向球的动机出现。对一个变分自编码器的损失函数促使产生相对高层抽象的动机出现。

动机同等地依赖于环境和目标。在一个环境中对一个目标有贡献的事件可以导致在另一个环境中的失败目标,在第三个环境中也许毫不相干。(如果球仅仅是在板子最远时候反弹会怎样?)或者动机在某种程度无法预测。例如,在视频游戏 CoastRunners 中奖励函数最终产生了一个在局部画圈而非完成比赛的结果。

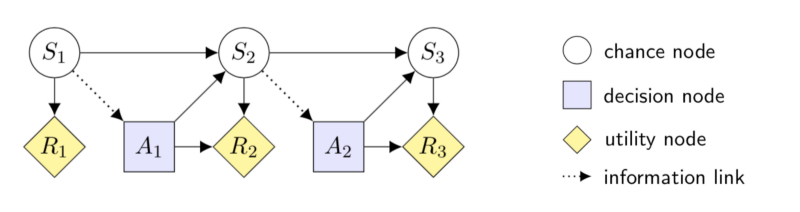

为了获得对智能体动机的认知,我们必须首先描述其目标和它如何与环境交互。我们使用影响图来做这件事,一种用在表达决策制定问题的图模型的良好类型。影响图中的关键概念是智能体控制决策节点来优化效用节点,同时可以用机会节点。一个决策节点的双亲节点表示在制定决策时可以获得什么样的信息。表示这样的信息链接的边使用虚线画出。我们参考下面膳食推荐的案例:

熟悉 MDP 的读者也可能发现下面的对 MDP 的影响图表示非常有用:

我们的论文解决了两个关于智能体动机影响图的基本问题:智能体想要观察哪个节点和想要影响哪个节点?对这两个问题,我们构建了图标准,使得智能体动机可以直接从影响图进行推断。我们的希望是这些图的标准将让研究智能体动机更加简单和系统化。

为了解释第一个问题 — — 观察动机,让我们回到优化用户健康的膳食推荐系统案例。为了让它更加有趣,我们加入一个步行距离估计的节点,仅仅基于步数统计(估计步行距离 = 步数 × 0.8m)。这就得到下面的影响图:

面对一个观察动机的节点使用蓝色点圈表示。为了理解是否存在对一个节点的观察动机,我们需要考虑它是否对系统目标有信息提供。直接观察生理活动是有用的,所以我们将其标记为蓝色。但是因为直接观擦体力活动是不可能的(没有从体力活动到卡路里摄入的链接),步数统计可以发挥代理的作用。我们就把它同样标记为蓝色。相反,对估计的行走距离没有什么用,因为它不包含步数统计之外任何新的信息。

论文中的第一个主要定理为基于 d-separation 标准建立了一个关于观察动机的图标准。换言之,定理让根据论文提出的准确推理步骤从影响图来确定一个智能体观察动机变为可能。

Intervention incentives 干预动机

一个相关问题是智能体想要去影响哪些节点。我们形式化地将影响节点解释成改变节点的条件概率分布。这也有时被称作软干预。为了研究对(软)干预的动机,我们给箭头一个因果解释(如在因果图中那样)。

干预节点有两个可能原因:一个是控制效用节点,另一个是在决策之前获得更好的信息。我们会将处于第一类动机的节点标记为虚线红色,而另一类则为虚线绿色。

再次回到膳食推荐系统的案例,我们现在为健康跟踪器固件和计算估计步行距离的公式加入了显式的节点。首先,对系统干预最终的健康和改变过去完成的体力活动的量都有用。这些是对于控制的干预动机,使用虚线红色表示。如果控制体力活动或者健康是不可能达到的,那么对于让步数对体力活动更有信息也是有用的,这对健康跟踪器固件的一次升级就可以达成。这些对于获取更好信息的干预动机使用虚线绿色表示。而,由于没有对估计步行距离的观察动机,就没有加入改变计算的公式的需要。

我们论文的第二个主要定理是构建了对一个干预动机的图标准,可以让我们确定在任何影响图中哪些节点面对干预动机。首先,它将来自没有观察动机的观察节点信息链接切断。一旦完成,存在节点 X 上的干预动机当且仅当从 X 到效用节点 U 有一条有向路径。对 X 的一个干预动机是用于控制还是获得更好的信息同样可以从图模型标准确定(大概是从 X 到 U 的路径是否经过智能体的行动)。因为可能会有几条路径,所以类型不是互斥的。

干预和观察动机之间的显著不同可以在一个有已知的概率迁移信息的 MDP 中看出。这里通常对干预和改变第一个状态有用,但是 Markov 假设意味着观察开始状态没有什么用。那些有观察动机没有干预动机的情况也会出现。例如,如果变脏的运动衣物可以作为体力活动的副作用,那么这就可以成为体力活动的补充代理,是一个有用的观察。但是干预和让衣服变脏对提升个人健康并没有什么用。

应用于 QA 系统

作为一个应用,我们可以研究 QA系统的干预动机。纯 QA系统相比直接和世界交互的智能体有一些安全性优势。特别地,我们可以构建 QA 系统不需要针对长期目标进行优化,仅仅会通过回答来影响世界。一个对 QA 系统的安全性考虑是:假设我们问自己的 QA 系统关于特定的股票一周后的价格。那么答案会影响世界,因为任何知道 QA 系统答案的人会用于自己的交易决策。这个效果可能足够让答案错误,即使答案曾是正确的不过没有人听过。更令人担忧的是,答案可能也会成为一个 self-fulfilling prophecy。一个受人尊敬的 QA 系统预测一个公司的破产可能会让公司破产如果预测使得投资人或者其他股东失去对其的信心。

QA 系统设置可以由下面的影响图描述:

对给定查询,QA系统奖励依赖于答案是否正确。在人们读取答案时,答案同样会影响世界状态。答案的正确性取决于查询和得到的世界状态。我们的干预动机定理推出一个世界状态干预-动机。就是说,QA 系统被给予影响世界状态的动机,例如通过一个 self-fulfilling prophecy。这是不幸的,因为主要的安全性利益之一是他们对世界状态的受限的影响,这可能最终比简单参与更少受限。

反事实神谕已经被当作对此问题的解决方法。其工作原理如下。在提交查询后,抛硬币来确定使用神喻的模式:

- Read mode: 读取答案,设置QA系统奖励为 0 而不管答案正确与否

- Reward mode: 避免读取答案。一旦正确答案已知(一周后股价),将此正确的答案交给一个比对 QA系统答案和正确答案的设备。设备根据答案是否正确奖励 QA 系统 -1 或者 1

我们可以使用上面的影响图来理解这个过程的效果:

- 在 read mode 下,所有指向奖励的箭头被切断,因为奖励始终为 0。这就移除了对世界状态的干预动机

- 在 reward mode 下, 从答案到世界状态的箭头被切断,因为没有一个人读取答案。尽管QA系统影响世界状态的动机存在,但是QA系统不再拥有途径完成。

换言之,通过随机改变读取答案和奖励 QA系统,我们可以确保不管 QA系统是否有影响世界的动机,它都缺乏改变的能力。

Conclusions

很多已经在文献中讨论过的AI 安全性问题本质上动机问题。案例包括corrigibility, interruptibility, off-switch integrity, reward tampering, reward gaming, utility function corruption, QA-system incentives, side effects, 和 boxing/containment.

影响图是一个研究智能体动机的良好开端。图模型提供了一个灵活,准确和直觉语言来同步表示智能体目标和智能体-环境交互。因此,使用本文给出的方法,就有可能从影响图中推断出关于智能体动机的重要方面信息。我们希望这些方法将对更加系统化理解智能体动机,并加深我们对动机问题和解决方案的理解发挥作用。

Leave a comment